Subtotal $0.00

A IA não cabe na tomada: por que NPUs, óptica e água estão redesenhando tudo

As filas não são por GPU. São por megawatts. Hiperscalers compram terrenos como quem compra cabo HDMI em promoção, mas o gargalo agora é subestação, fibra e água gelada. Enquanto isso, seu laptop já roda modelos que antes exigiam um rack inteiro. Sim, estamos encolhendo a IA e inflando a infraestrutura ao mesmo tempo.

Resultado: uma corrida em três frentes — eficiência energética, interconexão óptica e computação local com NPU. Quem ignorar qualquer uma delas vai gastar mais com eletricidade do que com engenheiros. E o financeiro não gosta quando o OPEX parece um foguete sem paraquedas.

1) Potência virou moeda dura: megawatts, não slides

Data centers de IA estão batendo densidades de rack que empurram ar-condicionado para a idade do bronze. O padrão caminhou de 10–20 kW/rack para 80–120 kW, com projetos mirando muito além disso. A rede elétrica não acompanha no mesmo ritmo: subestações levam anos, licenças ambientais travam, e regiões como norte da Virgínia, Irlanda e Singapura já impuseram limites ou curadorias de crescimento.

Como se responde a isso? Três movimentos aparecem em quase todo projeto grande:

- Geração e armazenamento no local: baterias de alta capacidade (UPS como recurso de rede), contratos com renováveis e, em alguns casos, cogeração e células a combustível para segurar picos.

- Reaproveitamento de calor: clusters no norte da Europa já esquentam bairros inteiros. Não é filantropia; vira fluxo de caixa e ajuda a licenciar expansão.

- Orquestração de carga: treinos em horários de energia barata; inferência geograficamente roteada para onde há kWh sobrando. Latência vira variável de negócio.

Tradução para produto: a arquitetura de IA precisa ser “grid-aware”. Se o seu scheduler ignora preço horário de energia e limites de subestação, você está queimando dinheiro — e talvez disjuntores.

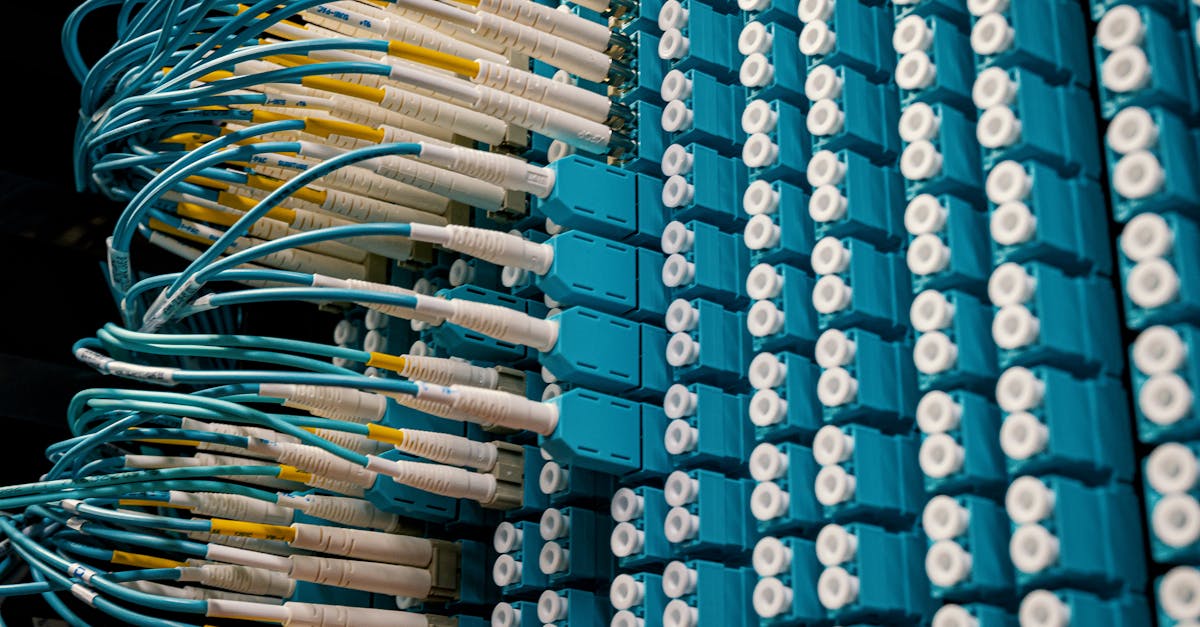

2) A fibra venceu: do backplane ao pacote

Quando o gargalo é mover bits, eficiência por bit vira obsessão. A transição para 800G e 1.6T em links óticos está acelerando com três tendências técnicas que saíram do paper e já começam a bater ponto no chão de fábrica:

- Óptica de drive linear (LPO): reduz a necessidade de DSPs famintos por energia, cortando watts por transceptor em topologias curtas de data center.

- Óptica co-encapsulada (CPO): em vez de plugar módulos na borda da placa, a óptica vai para junto do ASIC. Menos cobre, menos perdas, menos calor no caminho crítico. Ainda é nascente, mas a direção é clara.

- PCIe 6/7 e CXL 3.x: latência despenca e a memória vira pool compartilhado. Significa treinar/servir com menos cópias e menos energia para empurrar tensores por aí.

O motivo econômico é simples: cada picojoule economizado por bit vira margem. E a topologia conta. Arquiteturas com malhas óticas internas e domínios de memória coesos estão entregando throughput por watt melhor do que “ilhas de GPU” cheias de cabos passivos de cobre. Não é glamour, é física aplicada.

3) Água no chip, sem drama

Ar sozinho não dá conta de TDP de aceleradores modernos. O combo que mais cresce: cold plates direto no chip, manifolds no rack e portas traseiras com trocador de calor. Em ambientes extremos, imersão total.

O lado B: operações. Vazamentos, manutenção, treinamento de equipe. O lado A: densidade brutal por m² e menor energia para resfriar a mesma carga. Fabricantes alinharam padrões via comunidades como OCP, e fornecedores de colocation já oferecem “zonas líquidas”. À medida que a curva de TDP não desce, essa é a estrada principal.

Benefícios colaterais que quase ninguém coloca no slide de vendas: ruído acústico menor, layouts de sala mais flexíveis, e integração mais fácil com reaproveitamento de calor. O único detalhe é que agora seu SRE também fala de válvulas e vazão. Tudo bem: melhor aprender hidráulica do que queimar silício.

4) NPUs em todo lugar: a descentralização educada

Enquanto os data centers brigam por megawatts, dispositivos estão ganhando NPUs capazes de inferir modelos de linguagem e visão sem respirar fundo. Estamos falando de dezenas de TOPS com consumo de poucos watts, rodando quantização 4-bit, caches KV eficientes e decodificação especulativa. Tradução: tarefas que pareciam “sempre nuvem” cabem no bolso.

Casos concretos pipocam: varejo usando câmeras com detecção on-device para reduzir banda e garantir privacidade; indústria com inspeção visual na borda para não parar a linha; notebooks realizando sumarização e tradução offline com latência baixa o suficiente para parecer mágica. Além da experiência, existe o custo: cada requisição que não cruza a WAN é dólar salvo e risco a menos.

Arquitetura vencedora? Híbrida de verdade. Uma regra prática que funciona bem:

- Tier 0 (dispositivo): filtros rápidos, OCR, classificação leve, agentes contextuais.

- Tier 1 (edge local): modelos medianos, personalização, fusão de sensores.

- Tier 2 (nuvem de alto desempenho): MoE gigantes, RAG de grande escala, workloads bursty.

Com roteadores de requisição baseados em custo, latência e privacidade, dá para reduzir o tráfego de ida e volta e, de quebra, ficar de bem com compliance.

5) Memória é o novo petróleo: HBM, chiplets e o teto do retículo

Escalar compute sem escalar memória é receita para saturar barramentos. Por isso HBM virou rei. Pacotes com múltiplas pilhas atingem vários terabytes por segundo de largura de banda, e arquiteturas 2.5D/3D aproximam compute dos dados. Chiplets contornam o limite do retículo e permitem combinar IPs especializados — desde núcleos de propósito geral até motores de atenção e de convolução — em um só módulo.

Do ponto de vista de software, otimizações como FlashAttention, paged attention e kernels fundidos reduzem tráfego desnecessário. Mas o grande salto vem da co-projetação: hardware que “fala” o padrão de acesso de LLMs e modelos multimodais. A indústria entendeu que não dá para esperar que o compilador faça milagres sozinho.

6) Economia real: custo por token, água por métrica cúbica e watts por insight

Três métricas entraram no vocabulário do board:

- Custo de inferência por mil tokens/imagens. Otimizações de lote, quantização e MoE dinâmico impactam direto.

- Água por kWh e por inferência. Regiões com estresse hídrico exigem estratégias a seco, e isso afeta onde você expande.

- MW por emprego local e por dólar investido. Governos passaram a medir “qualidade” de data center, não só metragem construída.

Isso explica a migração para climas frios e energia barata (Nordics, Canadá, interior dos EUA), o interesse crescente por acordos de calor distrital e a pressa em padronizar telemetria ambiental auditável. Transparência virou vantagem competitiva.

7) Soberania, privacidade e o charme do ar-gap

Setores regulados e governos estão montando pilhas de IA em solo e rede próprios. Não é nacionalismo tecnológico vazio; é controle de dados e continuidade operacional. Modelos proprietários rodam em clusters air-gapped, enquanto dispositivos na ponta fazem pré-processamento com NPUs para minimização de dados. O resultado é uma malha de IA que negocia o que vai para a nuvem e o que morre localmente, com logs que um auditor entende sem precisar de um PhD em telemetria.

8) Riscos que ninguém quer admitir (mas precisam do seu CAPEX)

- Fornecimento de HBM e transceptores: ciclos de escassez vão definir prazos de projeto mais do que a sua folha de rota de software.

- Calor concentrado: pequenas falhas viram grandes paradas. Redundância térmica precisa de tanto carinho quanto redundância elétrica.

- Bloqueio de fornecedor: stacks de aceleração fechados brilham no benchmark e doem no lock-in. Abstrações abertas (CXL, formatos de pesos, runtimes portáveis) compram opcionalidade.

- Segurança de pesos e prompts: com inferência local, o risco migra. Exfiltração agora pode começar no seu laptop. Hardening e políticas de MDM não são opcionais.

9) Playbook pragmático para os próximos trimestres

Sem poesia, só ações:

- Mapeie a “árvore de latência” dos seus casos de uso. O que realmente precisa de hyperscale? O que pode morar no edge ou no dispositivo?

- Exija métricas de energia por inferência dos seus fornecedores. Sem isso, não há ROI, há fé.

- Padronize interconexão e memória com CXL e prepare-se para transição ótica mais agressiva no core.

- Planeje líquido agora, mesmo que comece a ar. A mudança é inevitável — melhor no seu cronograma do que no do fornecedor.

- Treine times de SRE para lidar com hidráulica, fibra e segurança de pesos. Ferramentas mudaram; responsabilidades também.

O que muda de verdade

Dois deslocamentos vão separar quem escala de quem patina. Primeiro: ótica e memória deixam de ser “componentes” e viram a arquitetura. O chip é importante, mas o caminho entre chips decide o custo marginal da sua IA. Segundo: o “default offline” volta pela porta da frente. Nossos dispositivos serão pequenos data centers, e a nuvem vira o tier caro e precioso — usado quando faz sentido, não por hábito.

Previsões sem rede de proteção? Óptica co-encapsulada vira padrão acima de certos patamares de largura de banda; cidades começam a licenciar data centers como se fossem usinas de calor; laptops com NPU se tornam a plataforma prioritária para agentes pessoais; e relatórios trimestrais passam a trazer “calor vendido” como linha de receita em mercados frios. A ironia é deliciosa: a era mais digital da história vai depender de canos, bombinhas e água correndo no lugar certo.

Se você lidera produto ou infraestrutura, comece a medir três coisas com obsessão: watts, bytes e metros (de fibra e de tubulação). O resto — modelos, features e buzzwords — só vale quando passa nesse crivo. E, por favor, teste os alarmes de vazamento antes de treinar aquele MoE gigante. Melhor piada pronta no laboratório do que manchete no jornal.