Subtotal $0.00

O novo gargalo da IA não é o chip — é o megawatt

Quanto vale um cluster de GPUs sem um ponto de conexão de 200 MW? Exato: uma obra de arte muito quente. A corrida por modelos maiores empurrou o problema para fora do rack e para dentro da subestação. Agora, tecnologia de IA é sinônimo de engenharia elétrica, hidráulica e ótica — e os CTOs estão aprendendo a falar com operadores de rede, fornecedores de fibra e fabricantes de válvulas de esfera.

Enquanto chips ficaram mais rápidos, a infraestrutura virou o verdadeiro quebra-cabeça. Interligações elétricas atoladas, calor que não tem para onde ir, fibra saturada em campi onde cada GPU exige centenas de gigabits sustentados. E no meio disso tudo, um detalhe que passa batido nas planilhas: o custo por megawatt disparou, e o megawatt ficou raro.

Energia: o backlog mais caro da IA

Clássico: você fecha contrato de milhares de aceleradores, planeja o data hall, e descobre que o lead time para interconexão ao grid passou de meses para anos. Por quê? Subestações e linhas de transmissão não escalam com o mesmo ciclo de 18–24 meses do silício. É aço, cobre, licenças, vizinhança e política. Resultado: os hiperescaladores passaram a construir ou cofinanciar subestações dedicadas, migrar para 230–400 kV na borda do campus e a operar microgrids com geração no local.

Três caminhos técnicos têm dominado as conversas de engenharia:

- Distribuição DC e 48 V: trocar múltiplas etapas AC por barramentos DC de 380–400 V com conversores de alta eficiência (GaN e SiC) reduz perdas e calor parasita. No rack, 48 V vira a tensão padrão para densidades acima de 30 kW, evitando trilhas grossas e quedas de tensão. Em alguns projetos, DC microgrids com retificadores frontais modulares simplificam redundância N+1 no nível do corredor.

- Armazenamento e resposta rápida: baterias de curta duração (5–15 minutos) dão margem para rampas de carga e evitam penalidades por demanda. Sistemas de flywheel ainda aparecem para transientes, e UPSs com dupla conversão viraram software-defined, com telemetria por fase e por breaker. Tudo para aguentar o “passo de dança” de treinos que variam carga em janelas de segundos.

- Geração no local: onde o grid não entrega, entram motores a gás de ciclo rápido, turbinas, células a combustível e PPAs com renováveis firmados por interconexão privada. Há pilotos experimentando integração com SMRs e geotermia, mas o grosso, por enquanto, é gás com captura de calor para aquecimento distrital.

Calor: o problema que não cabe mais no ar

Ventoinhas já perderam a batalha nos racks de alta densidade. A virada para direct-to-chip com cold plates selados virou mainstream nos clusters sérios, capturando 60–80% da carga térmica como água morna. Isso muda a arquitetura inteira do prédio: dois loops hidráulicos (secundário quente e primário de rejeição), manifolds com válvulas balanceadas, trocadores de calor de placas e bombas com controle VFD. A temperatura de saída? 45–60 °C, quente o suficiente para aproveitar em sistemas de aquecimento distrital sem gastar fortunas em elevação térmica.

Detalhes que decidem CAPEX e PUE:

- WUE sob auditoria: adiabáticos e torres evaporativas enfrentam restrições de consumo d’água. Projetos migram para dry coolers e chillers com free cooling prolongado, mesmo sacrificando um pouco de eficiência para ganhar licença e previsibilidade. Em climas frios, warm water cooling permite free cooling quase o ano todo.

- Roteamento hidráulico por chassis: quick disconnects sem gotejamento, sensores de vazamento por fibra ótica (sim, fibra para detectar água), e bandejas estanques. O medo de pingos às 3 da manhã não é lenda.

- Backplane térmico do prédio: passar de 10 para 100 MW muda a conversa para diâmetros de tubulação, perda de carga e ruído hidráulico. Computação virou HVAC hardcore com scripts.

Rede: se a GPU espera, dinheiro evapora

Treino distribuído adora latência baixa e throughput constante. O data center moderno é, na prática, uma grande máquina ótica. Três blocos técnicos mandam no jogo:

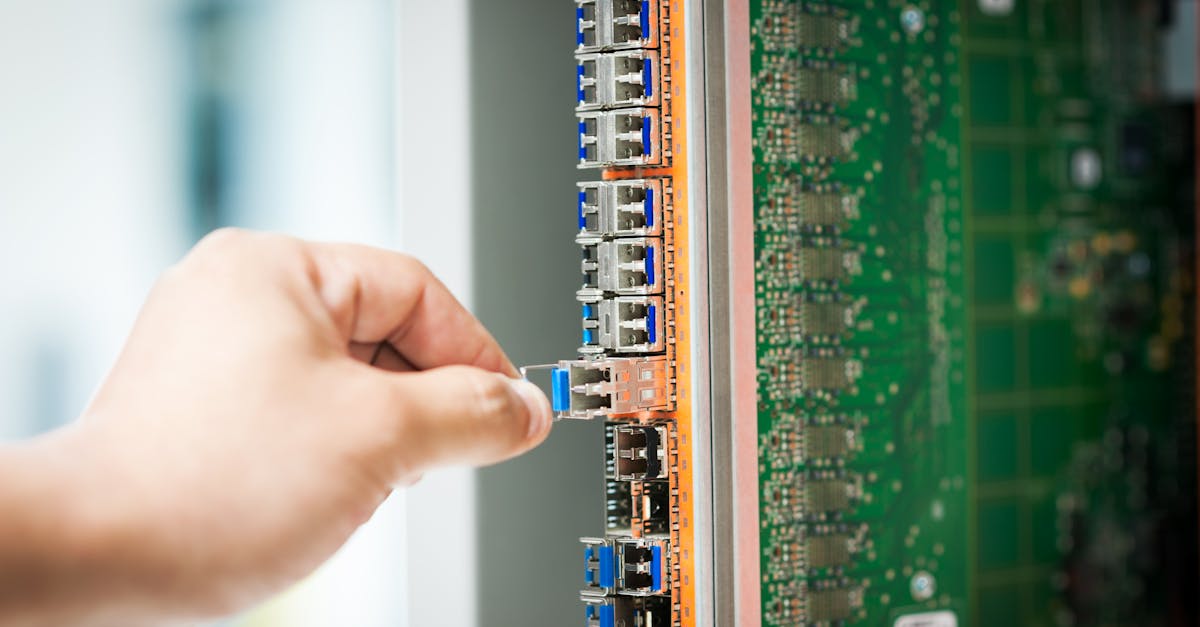

- 800G hoje, 1.6T na mira: módulos QSFP-DD800 e OSFP 800G viraram padrão em fabric leaf-spine. A transição para 1.6T traz PAM4/Coherent, equalização mais agressiva e orçamentos de potência térmica que não cabem no antigo plano de faceplate. Switches de 51.2T elevam a densidade e complicam a dissipação dentro do chassi.

- Óptica co-embarcada e fotônica de silício: mover o laser para perto do ASIC reduz perdas de cobre e consumo. Em escala, isso depende de cadeias de suprimento de transceptores e co-packaged optics maduras. A montagem fica mais próxima de uma linha de semicondutores do que de TI tradicional.

- Topologias e CXL: fabrics Ethernet de baixa perda avançam contra Infiniband em clusters massivos, por custo e escala operacional. Em paralelo, CXL 3.x abre pooling de memória entre servidores, reduzindo stranding de HBM e DRAM. O overhead de coerência ainda é tema quente, mas a direção é clara: mover dados menos, melhor.

Se parece muito hardware, é porque é. A parte divertida: cada fibra que entra no rack precisa de planejamento de rota, raio de curvatura, limpeza e inventário. “Só pluga aí” virou uma lenda urbana.

Chips, embalagens e a parede da HBM

Mesmo que a energia e a rede estejam resolvidas, há a barreira da manufatura avançada. HBM domina o custo e o cronograma de aceleradores. Empilhamentos altos, interposers grandes (CoWoS e afins), yield sensível. Resultado: capacidade de embalagem virou moeda estratégica. Quem garante wafer + HBM + empacotamento avança; o resto espera. Não é só “ter o GPU do ano”. É ter a fábrica que sabe colar tudo sem virar brinde caro.

Inferência na borda: menos tráfego, menos calor, menos drama

Enquanto o treino pede megawatts, a inferência escala melhor quando o modelo viaja para onde estão os usuários e sensores. PCs com NPU decente, smartphones com aceleradores e gateways industriais com módulos dedicados rodam quantização 4–8 bits, sparsity estruturada e operadores fundidos. Isso tira pressão da rede de longa distância e reduz latência percebida. Para muita aplicação, metade do ganho não vem de um modelo novo, mas de colocar o velho no lugar certo.

Exemplos práticos pipocam: varejo usando câmeras com processamento na borda para evitar backhaul de vídeo; automação logística com robôs conectados por 5G/privado e decisão local; contact centers com transcrição e redatores de resumo rodando em NPU do laptop, sincronizando só metadados. Menos ida e volta de dados significa menos cabos, menos switches, menos calor. Contabilidade agradece.

Economia real: CAPEX por megawatt e o “custo do atraso”

O número que assusta: o custo por megawatt em campi de alta densidade saltou com aço, cobre, mão de obra especializada e prazos de licenciamento. Entre terraplanagem, subestação, chillers e rede ótica, o CAPEX energético pode superar o custo dos servidores, dependendo da fase do ciclo. O OPEX segue: energia com contrato indexado, água tarifada por escassez, manutenção de bombas e filtros. Tudo isso precisa ser visto com o mesmo rigor que a folha de parâmetros do modelo. Entrega atrasada? Cada semana sem cluster rodando é perda de receita, atraso em features e risco competitivo. O “custo do atraso” entrou nas RFPs.

Riscos regulatórios e percepção pública

Licenças ambientais levam em conta ruído, pluma térmica, consumo d’água e impacto na rede local. Comunidades questionam por que a rua escurece quando o data center liga. Algumas jurisdições já falam em métricas obrigatórias de PUE e WUE auditadas, limites de carga por circuito e contrapartidas de calor útil. Moral da história: engenharia excelente sem licença é projeto imaginário.

Para onde isso vai

A infraestrutura de IA está virando uma indústria pesada com software por cima. O romance do “código é tudo” acabou no primeiro transformador esquentando.

O que muda quando o data center vira usina e aquecedor de bairro

Daqui para frente, três apostas parecem sólidas:

- Líquido como padrão: direct-to-chip será default para cargas de alto desempenho; imersão aparece em nichos ultradensos e ambientes hostis. Os prédios novos já nascem com hidráulica no DNA.

- Ethernet vence por escala: a gravidade econômica puxa fabrics Ethernet com aceleração em NICs e switches programáveis. Co-embarcados óticos fazem o resto. Infiniband segue em bolsões de latência extrema.

- NPUs por toda parte: a borda fica mais inteligente, cortando tráfego e aproximando a IA de quem paga a conta. Menos ida ao data center para tarefas previsíveis, mais GPU livre para o treino pesado.

Previsão ousada: veremos campi de IA operando como trigeração — eletricidade, resfriamento e calor útil — conectados a aquecimento distrital e apoiados por microgrids DC. Outro palpite: métricas de sustentabilidade específicas para IA (energia por token treinado, água por hora de GPU útil) viram linha obrigatória em auditorias e contratos. E uma última: part numbers de válvulas, transceptores 1.6T e cabos de 48 V viram item de debate em reuniões de produto. Quem não fala essas línguas, derrapa.

Se você lidera uma plataforma de IA, traga facilities, compras e utilidades para a sala agora. Modelo sem megawatt é só arquivo bonito.